デジタル世界を操作するインターフェースは、マウスによるクリックから、画面のタップ、スワイプ、ピンチ、視線操作、ジェスチャー操作など、様々な新しい技術が加わりました。

たとえばその先に「指を動かさなくても、タップしようと思うだけで選択できる」UIがあるとしたらどうでしょうか。

今回取り上げるAppleの特許は、まさにそのような未来を想像させる内容です。この特許では、HMD、つまりヘッドマウントディスプレイを装着したユーザーが、ボタンを見ながら「タップ操作をしよう」と考えたとき、その脳波などの生理データを使って、クリックや選択といった操作イベントを判断する仕組みが説明されています。

これは単なるSF的なアイデアではありません。特許明細書には、脳波、視線、瞳孔反応、頭や身体の動き、機械学習モデル、フィードバック表示などを組み合わせて、「考えただけの操作」を現実のUIに落とし込むための具体的な構成が説明されています。

この記事では、Appleの特許出願 US20260083387A1 の発明の革新性と今後の応用可能性について解説します。

(この記事にない図面は、US20260083387A1 からご参照ください。)

発明の概要

ユーザーがHMDなどのデバイスでコンテンツを見ているとき、画面内にはアイコンやボタンのようなユーザーインターフェース要素が表示されています。ユーザーはその要素を見ながら、通常であれば指でピンチしたり、クリックしたり、タップしたりして選択します。

この特許では、その物理的な操作を必ずしも要求しません。代わりに、ユーザーが「タップしよう」と考えたときに発生する脳活動信号、たとえばEEGデータを取得し、その信号パターンから「ユーザーは今、このUI要素を選択しようとしている」と予測します。そして、その予測に基づいて、クリック、選択、フィードバック表示、コンテンツ変更といった処理を実行します。

重要なのは、ここで想定されている物理動作(つまりタップ動作)は、実際に実行されてもよいし、実行されなくてもよい点です。つまり、健常なユーザーが通常操作を高速化するためにも使えますし、手や腕を自由に動かせないユーザーがアクセシビリティ機能として使うこともできます。

単なる「脳波で操作するデバイス」ではなく、XR空間における次世代の認知型ユーザーインターフェースが描かれているのです。

発明のポイント

脳波データからアクションの運動意図を抽出

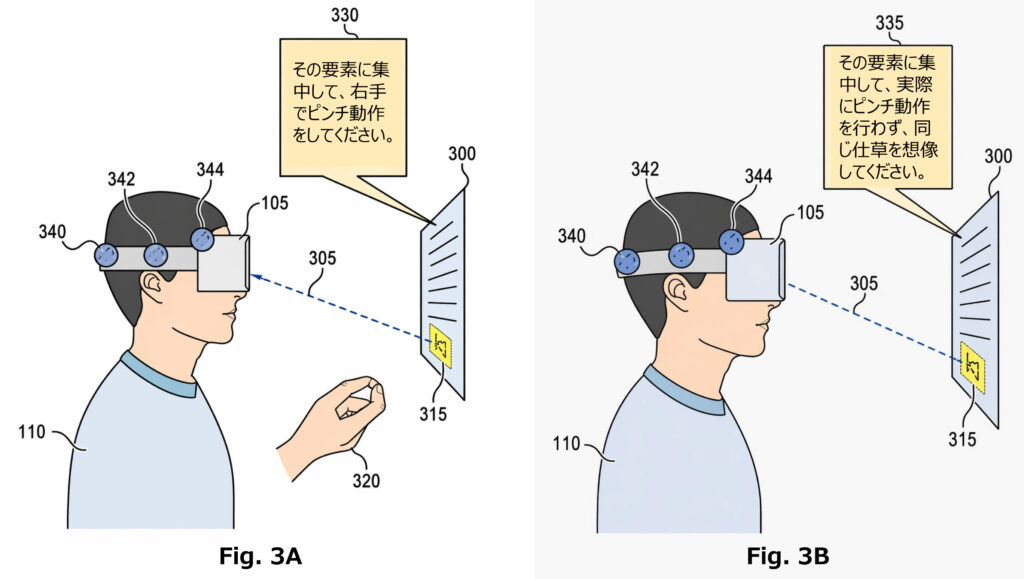

Fig.3A, Fig.3B では、ユーザー(110)がデバイス(105)を装着し、ユーザーインターフェース(300)上の操作要素(315)を見ています。ユーザーの視線方向は(305)として示され、デバイス(105)にはEEG信号を取得するための電極(340, 342, 344)が配置されています。

Fig.3Aでは、ユーザーに対して通知(330)が表示されます。その内容は、操作要素に集中し、右手でピンチジェスチャーを行うよう促すものです。右手(320)が実際にピンチ動作を行うことで、システムは「物理的にピンチしたときの脳活動信号」を学習できます。これはいわば、モデルにとっての教師データです。

一方、Fig.3Bでは通知(335)によって、ユーザーは同じ操作要素(315)に集中しながら、今度は実際に手を動かさず、「同じピンチジェスチャーを考える」よう促されます。

つまり、まず実際のピンチ動作によって基準となる信号を取得し、次に動作を伴わない「想像上のピンチ動作」による信号を取得することによって、脳波データから一定の共通性がある運動意図を検出しています。

(正確な図面は、US20260083387A1 をご参照ください。)

ピンチ動作を行った運動意図のEEGデータ

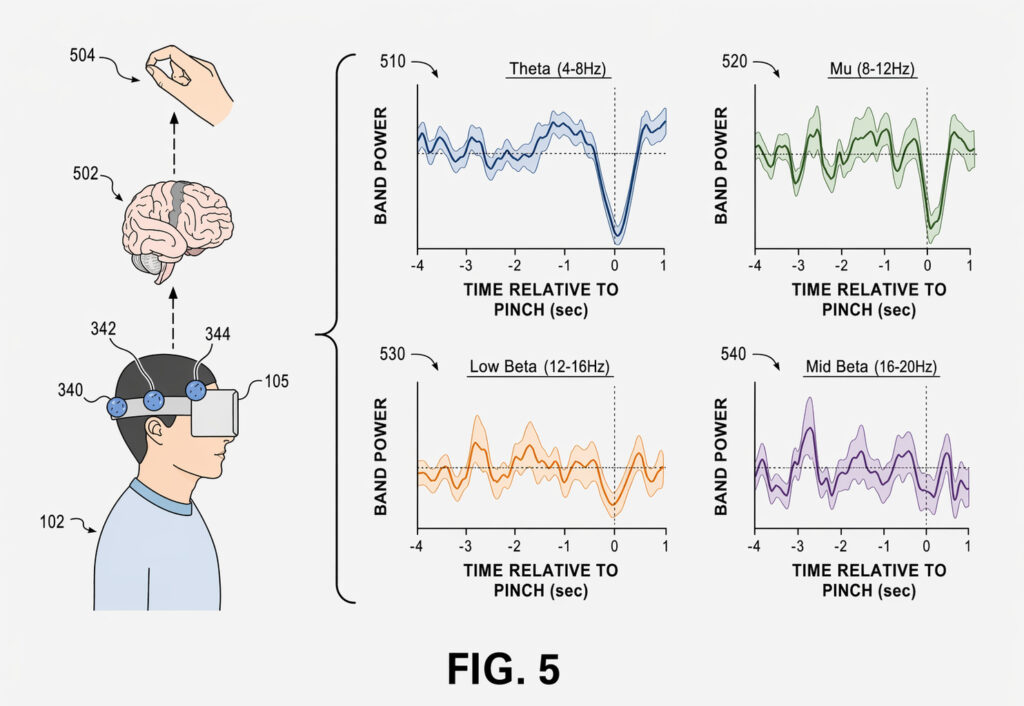

Fig.5 は、ユーザーの運動意図による脳活動信号の様子を示した図です。ユーザー(102)はデバイス(105)を装着し、右手(504)でピンチ動作を行う、またはその動作を考えています。頭部の強調部分(502)は、運動意図に関係する脳領域を示していると考えられます。図中には、Theta帯域、Mu帯域、Low Beta帯域、Mid Beta帯域に対応するグラフ(510, 520, 530, 540)が示されています。

Theta帯域は4〜8Hz、Mu帯域は8〜12Hz、Low Beta帯域は12〜16Hz、Mid Beta帯域は16〜20Hzの成分として説明されています。これらの帯域のパワーを、ピンチ動作またはピンチを考えたタイミングの前後で解析することで、ユーザーの運動意図を検出します。

特に興味深いのは、ユーザーがピンチを行う、またはピンチ動作を考えると、各帯域においてパワー低下のような変化が現れる点です。明細書には、たとえばMu帯域のパワーが50%低下することを、ピンチ意図の指標として扱う例が説明されています。もちろん実際の実装では、単純な閾値だけでなく、機械学習モデルが複数の周波数帯域や時系列変化を総合的に見て判断することになるでしょう。

(正確な図面は、US20260083387A1 をご参照ください。)

脳波で操作するグラフィックユーザーインターフェース

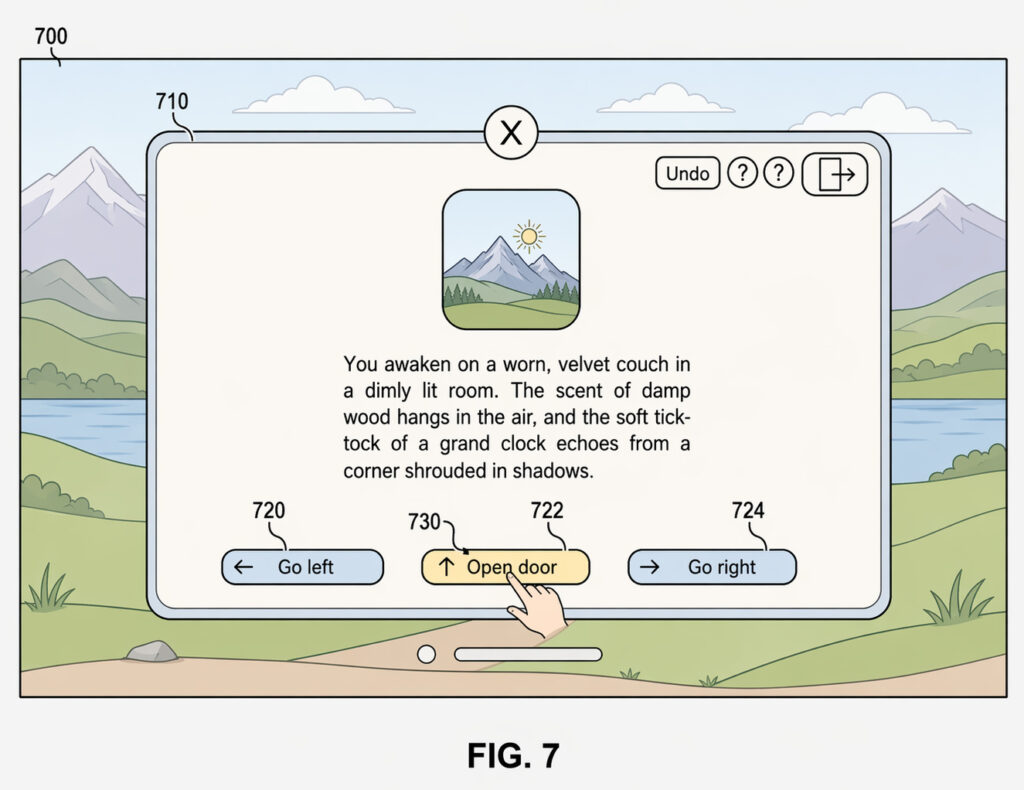

Fig.7 は、XR(クロスリアリティ)環境(700)の中に、2次元的なユーザーインターフェース(710)が表示されています。このUIは、インタラクティブなストーリーブックのような例として描かれています。操作要素(720)を選ぶと左へ進み、操作要素(724)を選ぶと右へ進み、操作要素(722)を選ぶと扉を開く、といった構成です。

ここでユーザーが操作要素(722)に注意を向け、ピンチすることを考えると、システムは運動意図を推定します。このUIでは、その推定結果をユーザーに伝えるために、仮想の手や腕に相当する要素(730)が表示されています。

この仮想の手(730)は、ユーザーの運動意図の検出レベルが高まるにつれて、仮想の手がピンチ動作をしている手に変化するアニメーションとなっています。つまり、ユーザーは「自分の考えがどの程度システムに伝わっているか」を視覚的に確認でき、この身体感覚に近いフィードバックにより、ユーザー自身が操作を学習できるようにしています。

(正確な図面は、US20260083387A1 をご参照ください。)

他の図面の説明

(図面は、US20260083387A1 をご参照ください。)

Fig.1:複数のユーザーがHMDを装着している実世界環境

Fig.1では、ユーザー(110, 130, 160)は、それぞれデバイス(105, 125, 165)を装着しており、デバイスは環境やユーザーの状態をセンサーで取得します。ここでは、HMDが視線、身体、周囲環境、さらには生理データを取得できる前提が示されています。

Fig.2A と Fig.2B:従来の操作と脳波コントロールでのユーザーの反応の違い

Fig.2Aでは、右手(237a)による実際のピンチ動作が示されます。一方、Fig.2Bでは、ユーザーは手を動かさず、ピンチを考えることで操作要素(250)を選択しようとします。ここでは、瞳孔データ(212a1, 222a, 232a)や脳活動データ(214a, 224a, 234a)、身体・頭部動作データ(216a, 226a, 236a)などを使って、実動作と想像上の操作を比較する構成が示されています。

Fig.4:EEGセンサーシステムによって取得される脳活動信号

Fig.4は、EEGセンサーのチャート(400)です。特に、C3センサー(410)、Czセンサー(412)、C4センサー(414)や、F3、Fz、F4に対応する脳活動信号(420, 422, 424)が説明されています。

Fig6:運動意図の脳活動信号に基づく減衰ばねフィードバックグラフ

Fig.6 は、脳活動信号から得られる「ピンチ信頼度」を、ユーザーに分かりやすいフィードバックへ変換します。グラフ(610)は生の脳活動信号に基づくピンチ信頼度を示し、グラフ(620)はそれにダンピングされたスプリングのような制御をかけた滑らかな信号を示します。

Fig.8:コンテンツ、視線、脳波、フィードバックをつなぐシステム全体図

環境(800)では、コンテンツ(802)がユーザー(110)に提示され、その周囲の環境(804)や操作要素(805)も含めて解析されます。コンテンツを提示するコンテンツ命令セット(810)、生理データを追跡する生理学的追跡命令セット(830)、UIフィードバックを生成するユーザーインターフェースフィードバック命令セット(840)、そして運動意図を予測する運動意図予測命令セット(850)が連携します。

Fig.9:本発明の方法を示すフローチャート

ブロック 902 では、操作要素を含むコンテンツ提示中に脳活動信号に関連する生理データを取得します。ブロック 904 では、そのデータに基づいて、ユーザーが身体の一部で物理動作を行うことを考えていると予測します。ブロック 906 では、その予測に基づいて、操作要素に関連するユーザーインタラクションフィードバックを決定します。

Fig.10 は、デバイス の内部構成を示すブロック図

処理ユニット(1002)、I/Oデバイスおよびセンサー(1006)、通信インターフェース(1008)、ディスプレイ(1012)、画像センサーシステム(1014)、メモリ(1020)などが示されています。メモリ内には、コンテンツ処理(1042)、生理追跡(1044)、文脈判断(1046)、運動意図予測(1048)の各命令セットが格納される構成です。

Fig.11:HMDの構造例

ハウジング(1101)、ディスプレイ(1110)、光学素子(1105)、眼球追跡用の光源(1122)とカメラ(1124)、外部環境や顔を撮影するカメラ(1132, 1134, 1136)が示されています。さらに、脳活動信号を取得するためのレシーバー(1140, 1142)とセンサー(1144, 1146, 1148)が配置されます。

応用可能性

- アクセシビリティ:特許には、麻痺のあるユーザーが脳活動信号を使ってコンピュータグラフィックのアイコンを選択するようなアクセシビリティ用途が説明されています。

- 操作の高速化:目で見て、指でピンチするという二段階の操作ではなく、「見る」だけでなく、「選ぼうと思う」ことでクリックできるようになれば、手がふさがっている場面、細かい操作が面倒な場面では、大きな意味を持つでしょう。

- ゲームや教育コンテンツ:魔法を使うゲームで、特定の対象を見ながら「発動しよう」と意図するだけでアクションを起こす。学習コンテンツでは、どのタイミングで答えようとしているかを推定し、より自然なインタラクションを実現する。従来のコントローラー操作とは異なる、かなり没入感の高い体験が生まれる可能性があります。

まとめ

- Appleの特許 US 20260083387 A1 は、EEGなどの生理データから「ピンチしようとする意図」を読み取り、XR空間のUI操作へ変換する技術を示しています。

- 従来のタッチ、クリック、ジェスチャーとは異なり、ユーザーの内面的な運動意図そのものを入力にする点が大きな特徴です。

- この技術は、アクセシビリティ、XR操作、ゲーム、教育、将来のVision系デバイスに大きな影響を与える可能性があります。

最後までお読みいただきありがとうございました。

特許情報

特許番号:US 2026/0083387 A1

タイトル:Motor Intention Prediction

発明者:Stephen Meisenhelter、Hyun Jong Won、Brian Pasley、Izzet B. Yildiz、Nikola Vukovic、Grant H. Mulliken、Eva Pilar Esteban Velasco

出願人:Apple Inc.

出願日:2025/9/24

公開日:2026/3/26

特許の詳細については US20260083387A1 を参照してください。

※企業の特許は、製品になるものも、ならないものも、どちらも出願されます。今回紹介した特許が製品になるかどうか現時点では不明です。ご注意ください。