ARやMR、VRといったデバイスでは、「ユーザーがどこを見ているか」を正確に把握できるかどうかが、体験の質を大きく左右します。仮想オブジェクトを選択する、UIを操作する、あるいは現実空間に仮想情報を重ねる――これらすべては視線追跡の精度に依存しています。

しかし、視線追跡は決して単純な技術ではありません。数ミリ、数度のズレであっても、仮想オブジェクトは「浮いて見える」「狙った位置に合わない」といった違和感を生み出します。

Appleが取得した特許 US12487667B2 は、こうした問題の根源である「視線方向」と「視線の起点(入射瞳)」のズレを補正する技術を提案しています。

(この記事にない図面は、この特許の出願公開 US20240103618A1 からご参照ください。)

特許の概要

従来の視線追跡では、赤外線を用いて瞳孔や角膜反射を検出し、そこから眼球モデルを生成します。

視線追跡の技術については、「視線を検出する技術」を参照してください。

このモデルには「光学軸(Optical Axis)」が含まれ、これが視線方向の代用として使われてきました。

しかし、人間が実際に見ている方向である「視軸(Visual Axis)」は、光学軸とは一致しません。しかもこのズレは個人差が大きく、単純な補正では吸収できません。

この特許では、

- エンロールメント(キャリブレーション)時に真の視線軸を推定

- XRデバイス固有のPoV(Point of View)カメラ座標系に補正

- 視力矯正用クリップオンレンズ装着時の光学的影響も考慮

という補正を行うことで、「本当に見ている位置」を高精度に再構成します。

図面の説明

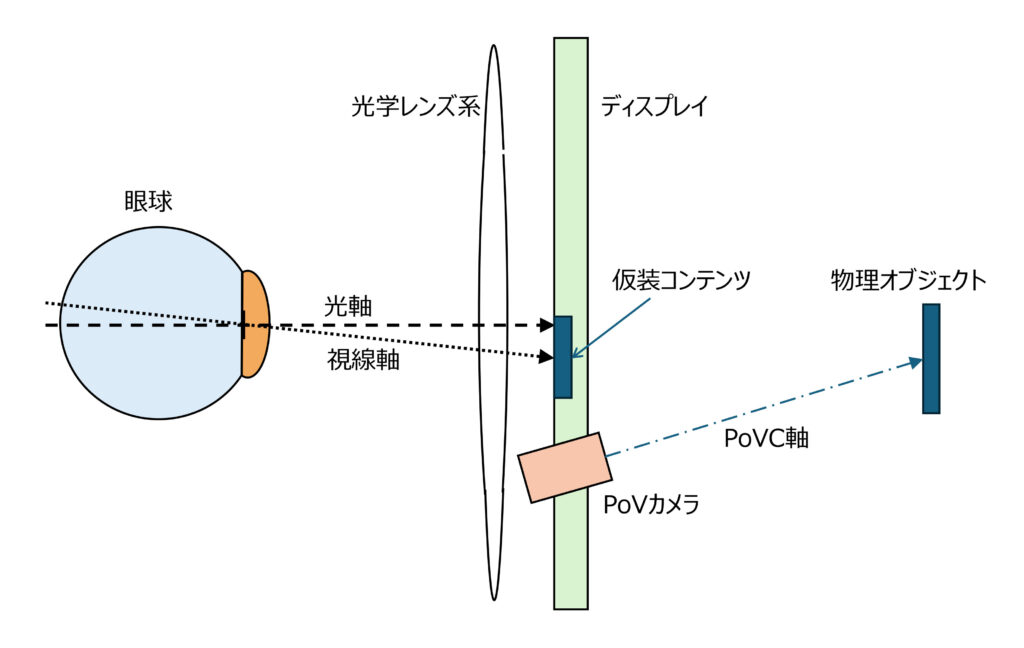

Fig.2:視軸に基づくPoV補正の中核概念(図面は出願公開 US20240103618A1 をご参照ください)

Fig.2は、本特許の技術思想を理解するうえで最も重要な図です。

XRデバイスでは、外界環境の動画を撮影するPoV(Point of View)カメラ(250)がレンダリングの基準点になります。ディスプレイ(230)上の仮想コンテンツ(272)は PoVC軸に基づいて決定されますが、視線追跡は眼球(200)の視線軸(222)を基準に行われるため、そのままでは座標系が一致しません。

Fig.2では、キャリブレーション時に推定された真の視線軸(232)を、PoVカメラの座標系のレンダリング原点(250)を起点とするよう変換する処理が示されています。これにより、ユーザーがディスプレイ上の「どの位置を見ているか」を、レンダリング原点(250)を起点として整合した形で求めることができます。

このPoV補正によって、仮想オブジェクト(272)はユーザーの視線と自然に一致し、AR表示にありがちな微妙なズレが解消されます。

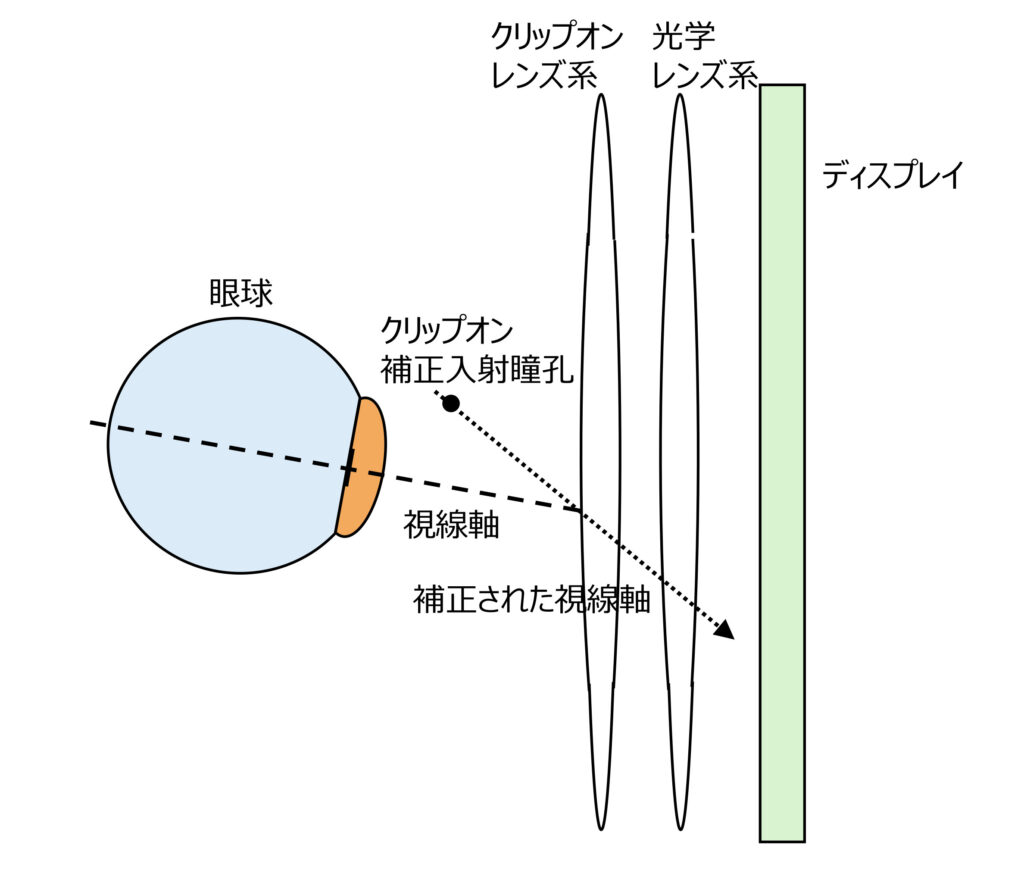

Fig.3:クリップオンレンズを考慮した視線・入射瞳補正(図面は出願公開 US20240103618A1 をご参照ください)

Fig.3は、視力矯正用のクリップオンレンズ(334)を装着した場合の補正処理を示しています。

レンズは視線方向を屈折させるだけでなく、視線の起点である入射瞳の位置も変化させます。これを無視すると、歪み補正や注視点推定の精度が大きく低下します。

本特許では、レンズの光学特性を取得したうえで視軸をレイトレーシングし、さらにクリップオンレンズ(334)を通る複数の仮想光線を用いて補正後のクリップオン補正入射瞳(338)を推定します。Fig.3は、この幾何学的な補正プロセスを視覚的に示した図です。

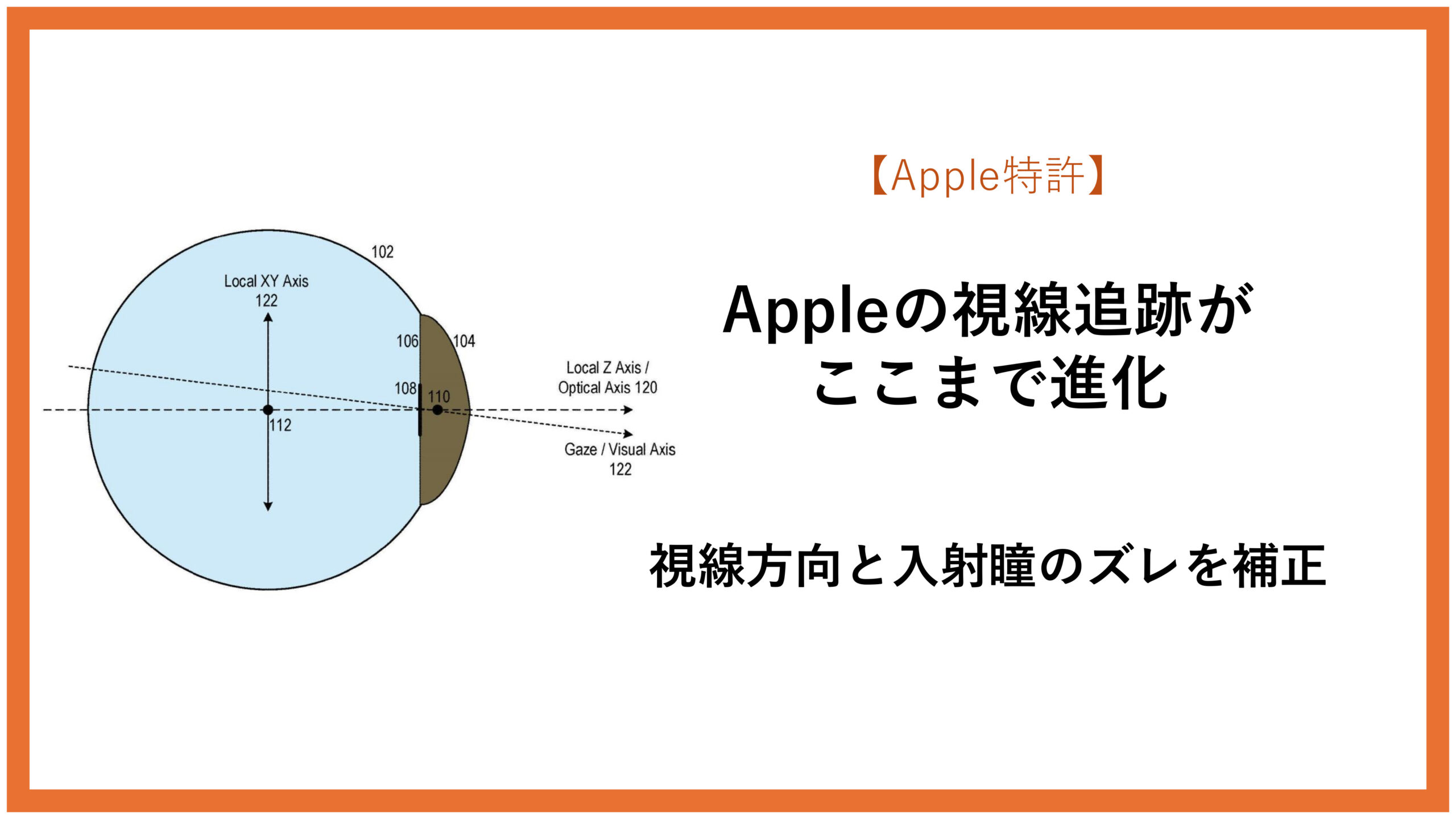

Fig.1:人間の目における光学軸と視線軸の違い(図面は出願公開 US20240103618A1 をご参照ください)

Fig.1は、光学軸(120)と視線軸(122)の違いを示す基本図です。

人間の目における光学軸と視線軸が一致しないという従来技術が抱えていた根本的なズレが視覚的に理解できます。

Fig.4A〜4C:HMDの外観(図面は出願公開 US20240103618A1 をご参照ください)

Fig.4Aは、単一レンズ構成のHMD側面図です。

視線追跡カメラやPoVカメラの配置関係が示されています。

特定形状に依存しない実装を想定していることが分かります。

Fig.4Bは、左右独立レンズ構成のHMD正面図です。

両眼それぞれに視線補正を適用できる設計が前提です。

将来の高精度両眼視線追跡を見据えています。

Fig.4Cは、異なる外観デザインのHMD例です。

視線追跡技術が筐体設計を制約しないことを示しています。

Fig.5:(図面は出願公開 US20240103618A1 をご参照ください)

エンロールメント処理全体の流れを示す図です。

視線軸推定とレンズ補正が段階的に行われます。

Fig.6:(図面は出願公開 US20240103618A1 をご参照ください)

視線軸を推定する具体的手順を示します。

ターゲット注視時の差分から個人特性を算出します。

視線補正の精度を左右する重要工程です。

Fig.7:(図面は出願公開 US20240103618A1 をご参照ください)

クリップオンレンズ補正処理のフローチャートです。

光学特性取得とレイトレーシングが示されています。

入射瞳補正まで含める点が特徴です。

Fig.8:(図面は出願公開 US20240103618A1 をご参照ください)

使用中に行われるPoV補正の処理フローです。

リアルタイムで視線補正が適用されます。

XR体験中に常時動作する中核処理です。

Fig.9:(図面は出願公開 US20240103618A1 をご参照ください)

補正結果を用いた表示コンテンツ調整の流れです。

仮想オブジェクトの表示位置が視線に追従します。

違和感のないAR重畳表示を支えます。

Fig.10:(図面は出願公開 US20240103618A1 をご参照ください)

レンズ補正とPoV補正の適用順序を示しています。

まずレンズ補正、その後PoV補正という構成です。

Fig.11:(図面は出願公開 US20240103618A1 をご参照ください)

XRデバイス全体のブロック構成図です。

発明のポイント

この特許の本質は、視線のズレを「誤差」ではなく「人間の特性」として扱っている点にあります。

従来はモデルを単純化することで対応してきた問題に対し、Appleはキャリブレーション工程そのものを再設計しました。

さらに、視線方向だけでなく入射瞳まで補正対象に含めたことで、フォービエイテッドレンダリングや歪み補正の精度が飛躍的に向上します。これはXRを“展示技術”から“実用品”へ進化させるための重要な一歩です。

今後の展望

本技術はVision Proクラスの高性能デバイスに限らず、将来的な軽量ARグラスにも不可欠な要素となるでしょう。特に視力矯正レンズを前提とした設計は、一般ユーザーへの普及に直結します。

また、視線追跡精度の向上は、消費電力削減やUXの自然さにも寄与します。XRが「日常的なコンピュータ」になるための基盤技術といえます。

まとめ

- 視線追跡は容易にズレが生じ、理想モデル通りには動きません。US12487667B2 は、このズレを前提条件とした特許です。

- キャリブレーション時に推定された真の視線軸を、PoVカメラの座標系へと変換することにより、ユーザーがディスプレイ上の「どの位置を見ているか」を、レンダリング視点と整合した形で求めることができます。

最後までお読みいただきありがとうございました。

特許情報

特許番号:US 12,487,667 B2

タイトル:Corrected Gaze Direction and Origin

発明者:Julia Benndorf, Qichao Fan, Julian K Shutzberg, Paul A Lacey, Hua Gao

出願人:Apple Inc.

登録日:2025/12/2

出願日:2023/9/19

特許の詳細については、US12487667B2を参照してください。

※企業の特許は、製品になるものも、ならないものも、どちらも出願されます。今回紹介した特許が製品になるかどうか現時点では不明です。ご注意ください。